恐怖を感じる。とても怖い。

人工知能 (AI) の想像を絶する膨大な計算能力によって、インターネット全体にわたる監視と検閲が可能になりました。

これは未来のディストピアではありません。それが今起きています。

政府機関は大学や非営利団体と協力して、AI ツールを使用してインターネット上のコンテンツを監視および検閲しています。

これは政治的でも党派的なものでもありません。これは特定の意見やアイデアに関するものではありません。

何が起こっているのかというと、インターネット上での言動すべて(またはその大部分)を監視するのに十分強力なツールが政府に利用可能になり、私たち全員を常時監視できるようになっているということです。そして、その監視に基づいて、政府、および政府が提携する組織や企業は、同じツールを使用して、気に入らない言論を抑圧し、沈黙させ、閉鎖することができます。

しかし、それだけではありません。同じツールを使用して、政府とその官民の「非政府」パートナー (たとえば、世界保健機関やモンサントなど) も、インターネットにリンクされたあらゆる活動を遮断することができます。銀行取引、売買、教育、学習、娯楽、相互接続 – 政府管理の AI があなた (またはあなたの子供!) のツイートやメールでの発言が気に入らない場合、それらすべてをシャットダウンすることができます。あなた。

はい、私たちはこれを非常にローカルで政治化した規模で見てきました。たとえば、 カナダのトラック運転手.

しかし、もしこの種の活動が国家規模(あるいはもっと恐ろしいのは世界規模)で起こるはずがない、あるいは起こらないだろうと考えているのであれば、私たちは今すぐに目を覚まし、それが起こっていることを認識する必要があり、それは止められないかもしれない。

新しい文書は、オンライン検閲を目的とした政府資金提供の AI を示している

連邦政府の兵器化に関する米国下院特別小委員会 2023年XNUMX月に設立され、「行政府機関による米国国民に関する情報の収集、分析、配布、使用に関する問題を調査する。そのような取り組みが違法、違憲、または非倫理的かどうかも含めて」。

残念ながら、委員会の活動は、その委員自身からも、主に政治的なものとみなされている。保守派議員らは、リベラル寄りの政府機関による保守派の声の沈黙と思われるものを調査している。

それにもかかわらず、この委員会は調査の中で、アメリカ国民の言論を検閲しようとする政府の試みに関連するいくつかの驚くべき文書を発見した。

これらの文書は社会全体に重大かつ恐ろしい影響を及ぼします。

小委員会の中間報告では、 5年2024月XNUMX日付け、文書によると、学術団体や非営利団体がAI「誤情報サービス」を利用してインターネットプラットフォーム上のコンテンツを検閲する計画について政府機関に売り込んでいる。

具体的には、ミシガン大学は全米科学財団(NSF)に対し、NSFが資金提供するAIを活用したツールを利用すれば、何を検閲すべきかを実際に決定することなく、ソーシャルメディアプラットフォームによる検閲活動を支援できると説明している。

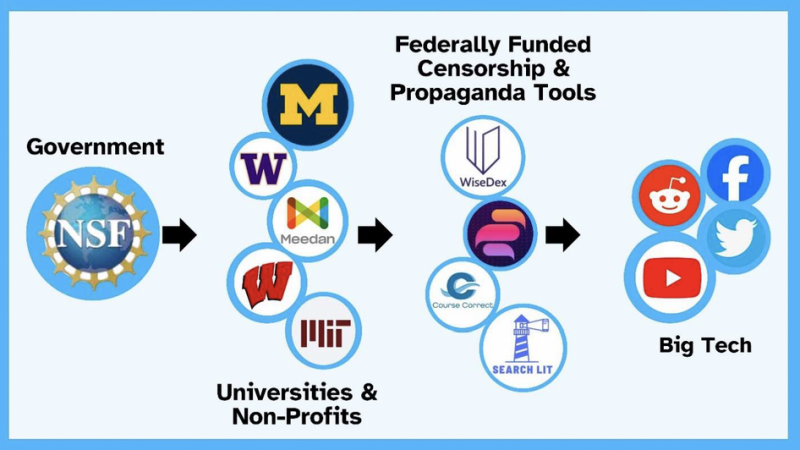

この関係が小委員会の報告書でどのように視覚化されているかは次のとおりです。

小委員会の報告書に示された具体的な引用は次のとおりです。これは、「ミシガン大学が国立科学財団 (NSF) に資金提供し、AI を活用した WiseDex ツールについて最初に提案した講演者のメモ」から来ています。メモは委員会に保管されています。

当社の誤報サービスは、検閲の困難な責任を外部に出すことで…難しい判断に対する責任を社外に押しつけたいと考えているプラットフォームの政策立案者を支援します。

これは非常に多くのレベルで異常な声明です。

- それは明らかに「誤報サービス」を検閲と同一視している。

これは非常に重要な方程式です。なぜなら、世界中の政府は、実際には有害な誤情報と戦っているふりをしているからです。 大規模な検閲法案を可決するを選択します。 WEF宣言 「誤った情報と偽情報」は今後2年間で「最も深刻な世界的リスク」となるが、これはおそらく彼らの最大の努力が検閲に向けられることを意味している。

政府の請負業者が、オンライン プラットフォームの「検閲の外部化」を支援する「誤情報サービス」を販売していると明確に述べた場合、この 2 つの用語は互換性があるものとして認識されます。

- 検閲を「責任」として言及している。

言い換えれば、プラットフォームが行うべきことの一部が検閲であると想定しているのです。子どもたちを性犯罪者から守ることも、罪のない国民を誤った情報から守ることもせず、単純明快で純粋な検閲を行っているだけです。

- AIの役割は検閲の責任を「外部化」することだと述べている。

テクノロジープラットフォームは検閲に関する決定を下すことを望んでいません。政府はこうした決定を下したいと考えているが、検閲とみなされることは望んでいない。 AI ツールを使用すると、プラットフォームは検閲の決定を「外部化」でき、政府は検閲活動を隠すことができます。

これらすべてにより、世界中の政府が「誤った情報とヘイトスピーチへの対策」と呼んでいるものは、直接的な検閲ではないという幻想に終止符が打たれるはずだ。

AI検閲が完全に導入されると何が起こるのでしょうか?

政府がすでに AI 検閲ツールの費用を支払っていることを知っているので、私たちはこれが何を意味するのかを理解する必要があります。

人員制限なし: 小委員会の報告書が指摘しているように、政府のオンライン検閲には限界があり、これまでは膨大な数の人間が無限のファイルを調べて検閲の決定を下す必要があった。 AI を使用すると、人間が関与する必要はほとんどなくなり、監視できるデータの量は、特定のプラットフォーム上で誰かが発言した内容と同じくらい膨大になる可能性があります。その量のデータは、個々の人間の脳では理解できません。

誰も責任を負いません: AI 検閲の最も恐ろしい側面の 1 つは、AI が検閲を行う場合、政府、プラットフォーム、大学/非営利団体など、実際に検閲に責任を負う人間や組織が存在しないことです。最初は、人間が AI ツールにどのカテゴリまたは種類の言語を検閲するかの指示を与えますが、その後は機械が先に進み、ケースバイケースの決定をすべて単独で行います。

苦情に対する訴えは受けられません: AI が一連の検閲命令を解き放つと、数十億のオンライン データ ポイントを一掃し、検閲措置を適用します。 AI の検閲行為に異議を唱えたい場合は、機械に話しかける必要があります。おそらく、プラットフォームは異議申し立てに対応するために人間を雇用するでしょう。しかし、こうした対応を自動化できる AI があるのに、なぜそのようなことをするのでしょうか?

若者に対する保護はありません: 政府の検閲官が主張する主張の1つは、子どもたちを拒食症にしたり、自殺を促したり、ISISのテロリストに仕立て上げたりするコンテンツなど、有害なオンライン情報から子どもたちを守る必要があるというものだ。性的搾取からも。これらはすべて注目に値する深刻な問題です。しかし、膨大な数の若者にとって、AI検閲ほど危険ではありません。

AI 検閲によってもたらされる危険は、オンラインで多くの時間を費やすすべての若者に当てはまります。なぜなら、AI 検閲は、オンラインでの活動や言葉遣いが監視され、彼らに対して使用される可能性があることを意味するからです。今はそうではないかもしれませんが、政府が特定のタイプを追及することを決定したときはいつでも、言葉や行動のこと。これは、子どもたちがオンラインで行うすべての活動を網羅し、生活のほぼすべての側面に触れるため、特定のコンテンツによってもたらされる危険よりもはるかに多くの子どもたちにとって、はるかに大きな危険です。

この危険性を説明する例を次に示します。あなたのティーンエイジャーがオンラインでインタラクティブなビデオ ゲームをたくさんプレイしているとします。彼がたまたま中国企業が設計したゲームを好むとしましょう。おそらく彼は、他の人がそれらのゲームをプレイしているのを見たり、多くの中国人も参加しているそれらのゲームに関するチャットやディスカッショングループに参加したりしているのでしょう。

政府は来月か来年、中国が設計したビデオゲームに深く関与する者は民主主義にとって危険であると決定するかもしれない。その結果、息子さんのソーシャルメディアアカウントが閉鎖されたり、大学ローンなどの金融ツールへのアクセスが拒否されたりする可能性があります。また、就職サイトや出会い系サイトで彼に危険または望ましくないとしてフラグを立てることも含まれる可能性があります。それは彼がパスポートを拒否されたり監視リストに入れられたりすることを意味するかもしれない。

あなたのティーンエイジャーの人生はさらに困難になりました。 ISISの勧誘ビデオや自殺を美化するTikTokの投稿にさらされた場合よりもはるかに困難だ。そしてこれは、以前よりもはるかに大規模に起こるでしょう。 検閲官が利用している性的搾取 政府によるオンライン検閲の概念を常態化させるトロイの木馬として。

収益化可能な検閲サービス:理論的には、政府が所有する AI ツールは、政府の許可を得て、検閲の「責任」を「外部化」したいプラットフォームの恩恵を受けて、非政府機関が使用することができます。したがって、政府は AI を使用して、たとえば反戦感情を監視し抑制しているかもしれませんが、企業は AI を使用して、たとえば反ファストフード感情を監視し、抑制することができます。政府はAIツールのサービスをサードパーティに販売することで多額の利益を得る可能性がある。プラットフォーム側が減額を要求する可能性も考えられる。したがって、AI 検閲ツールは政府、技術プラットフォーム、民間企業に利益をもたらす可能性があります。このインセンティブは非常に強力であるため、悪用されないということはほとんど不可能です。

進路を逆転できるでしょうか?

AI 検閲ツールを使用している政府機関とプラットフォームの数はわかりません。どれくらいのスピードで規模を拡大できるかはわかりません。

政府の検閲を防ぎ、インターネット上での AI ツールの使用を規制するために、意識を高め、政治家に働きかけ、訴訟を起こす以外に、私たちが自由に使えるツールが何なのかはわかりません。

他にアイデアがある場合は、今がそれを実行するときです。

の下で公開 Creative Commons Attribution4.0国際ライセンス

再版の場合は正規リンクをオリジナルに戻してください。 褐色砂岩研究所 記事と著者。